🚀 L'IA générative, nouvel allié de la santé-sécurité au travail

- L'équipe « SquadrAI»

- 28 avr. 2025

- 14 min de lecture

Introduction

L'intelligence artificielle générative s'impose graduellement comme un allié inédit pour la santé et la sécurité au travail (SST) au Québec et au Canada. Grâce au prompt engineering – l'art de formuler des requêtes efficaces pour orienter l'IA – les organisations innovantes exploitent désormais des modèles comme ChatGPT pour améliorer leurs pratiques de SST.

Rapports d'incidents automatisés, analyse proactive des risques, formations immersives : les applications foisonnent et les premiers résultats sont prometteurs.

Dans un contexte où chaque accident évité compte et où la conformité réglementaire est scrutée, l'IA offre des moyens inédits pour redoubler de vigilance sans alourdir les processus. Cet article fait le point sur cette révolution en cours, en s'appuyant sur les dernières données disponibles en avril 2025, et examine comment le prompt engineering peut décupler l'impact de l'IA en milieu de travail.

Enjeux actuels en SST : complexité, données et besoin d'innovation

Malgré des progrès constants, le domaine de la SST fait face à des défis persistants. Les milieux de travail modernes génèrent une multitude de données (observations, quasi-accidents, rapports d'audit), qu'il est souvent difficile d'analyser finement faute de temps ou d'outils adaptés.

Parallèlement, la réglementation en matière de SST est abondante et évolutive : rester conforme à toutes les exigences (normes CSA, lois provinciales, etc.) peut vite tourner au casse-tête, surtout pour les PME. Enfin, on observe encore trop d'accidents de travail et maladies professionnelles qui pourraient être évités avec une meilleure anticipation des risques.

C'est ici qu'intervient l'IA générative : en automatisant l'analyse et en facilitant la diffusion du savoir, elle peut aider à lever ces obstacles.

Pourquoi l'IA maintenant ?

D'une part, la maturation des algorithmes et la disponibilité de données permettent à l'IA d'être efficace là où, il y a quelques années, elle n'était pas fiable.

D'autre part, la pandémie et la transformation du travail ont accéléré la numérisation des processus, ouvrant la voie à des outils d'IA directement intégrés dans les flux de travail.

Concrètement, cela signifie qu'aujourd'hui un agent conversationnel peut parcourir en quelques secondes des milliers de lignes de procédures de sécurité ou d'archives d'inspection pour en extraire les points d'attention.

Le prompt engineering joue un rôle crucial : c'est grâce à des prompts bien conçus que ces IA peuvent fournir la bonne information au bon moment (par exemple, un rappel contextuel d'une norme lors de la planification d'une tâche dangereuse).

Les enjeux de SST – réduire les accidents, améliorer le bien-être, garantir la conformité – trouvent dans l'IA un vecteur d'innovation sans précédent.

Statistiques clés : l'adoption de l'IA en SST en chiffres

Plusieurs études récentes illustrent l'adoption rapide de l'IA (et de l'IA générative en particulier) par les organisations, ainsi que ses impacts potentiels sur la SST :

Adoption de l'IA générative au Québec et au Canada

Selon un sondage mené par KPMG en 2024, 76% des organisations québécoises interrogées affirment avoir adopté des outils d'IA générative dans leurs opérations – un taux d'adoption nettement supérieur à la moyenne nationale (environ 61%). Ce chiffre impressionnant signifie que près de 3 entreprises québécoises sur 4 explorent déjà ChatGPT ou des solutions similaires pour différentes fonctions (formation, RH, SST, etc.).

Il est à noter que près de la moitié de ces adopteurs (46%) indiquent même avoir intégré l'IA générative dans leurs flux de travail quotidiens de façon complète, gage d'une maturité d'utilisation grandissante. Au niveau pancanadien, plus de 6 organisations sur 10 utilisent l'IA générative d'une manière ou d'une autre, ce qui reste un taux élevé en seulement quelques années d'existence de ces technologies.

Impact sur la sécurité et les accidents

Bien qu'aucune méta-étude publique n'ait encore chiffré précisément la diminution des accidents liée à l'IA, des pilotes industriels laissent entrevoir des gains notables. Certaines entreprises manufacturières rapportent par exemple une baisse à deux chiffres du nombre d'incidents après l'implantation de systèmes d'IA de surveillance des comportements à risque (caméras intelligentes, alertes en temps réel).

Des chiffres de réduction d'accidents de l'ordre de 20 à 30% ont été évoqués lors de colloques récents pour des sites ayant combiné IoT et IA analytique.

Néanmoins, ces ordres de grandeur illustrent bien le potentiel : même une réduction de 10 ou 15% du taux d'accidents grâce à l'IA représenterait des centaines d'accidents évités chaque année au Québec, améliorant d'autant la qualité de vie des travailleurs.

Amélioration de la conformité et de la gestion des risques

L'IA est également perçue comme un accélérateur de conformité. Un rapport interne d'un grand cabinet de conseil suggérait en 2024 que les entreprises utilisant l'IA pour suivre leurs obligations EHS (environnement, hygiène, sécurité) constatent une amélioration d'environ 40% de leur conformité réglementaire – notamment en évitant des oublis et en détectant plus tôt les écarts.

En pratique, cela se traduit par moins de non-conformités relevées lors d'audits et inspections, et par des systèmes d'alerte proactifs (par ex. l'IA qui signale qu'une formation obligatoire vient d'expirer pour tel employé ou qu'une nouvelle norme entrera en vigueur).

Ce chiffre de +40% provient d'analyses ponctuelles et mériterait d'être consolidé, mais il donne une idée de l'ampleur du gain possible. À l'échelle macro, une meilleure conformité de quelques dizaines de pourcents signifie moins d'amendes, et surtout une prévention plus rigoureuse des situations dangereuses.

Compréhension de la valeur et retombées

Malgré ces tendances positives, tous les dirigeants ne se sentent pas encore au fait de l'IA. Toujours en 2024, seulement 28% des leaders interrogés disaient comprendre pleinement la valeur ajoutée par l'IA générative dans leur organisation (source : indice d'adoption numérique Deloitte, 2024).

Dit autrement, près de 3 décideurs sur 4 reconnaissaient avoir du mal à évaluer précisément comment l'IA contribuait à leurs objectifs d'affaires (et SST). Cette statistique reflète un certain décalage entre l'engouement pour la technologie et la capacité à en mesurer les bénéfices concrets.

Toutefois, on s'attend à ce qu'en 2025 ce pourcentage évolue à la hausse, grâce aux retours d'expérience accumulés et à la montée en compétence des équipes sur ces outils. Déjà, on voit émerger des indicateurs de performance spécifiques à l'IA (par exemple le « nombre de quasi-accidents identifiés par l'IA ») qui aideront à mieux quantifier la valeur de ces systèmes dans le futur.

Note: Certaines données chiffrées ci-dessus proviennent d'enquêtes et de retours d'expérience initiaux. Elles donnent des tendances utiles mais doivent être mises à jour régulièrement à mesure que de nouvelles recherches sont publiées.

Solution émergente : le prompt engineering au service de la SST

Comment exploiter concrètement l'IA générative en SST ? La clé réside en grande partie dans le prompt engineering, c'est-à-dire la manière de « dialoguer » avec l'IA pour qu'elle fournisse des résultats pertinents et fiables dans un contexte de santé-sécurité.

Contrairement à un logiciel classique, une IA comme ChatGPT n'est pas pré-câblée pour la SST ; elle doit être guidée par des instructions précises. Voici comment le prompt engineering se traduit en actions concrètes dans ce domaine :

1. Génération de contenus SST

Un responsable SST peut utiliser un prompt tel que « Rédige-moi une procédure de travail sécuritaire pour l'entretien d'une machine X, en respectant les normes canadiennes applicables ». L'IA générative, correctement aiguillée, va produire un brouillon de procédure structuré incluant les mesures de prévention standard.

Cela fait gagner un temps précieux en élaboration de documentation. L'expertise humaine reste nécessaire pour revoir et valider le contenu, mais le gros du travail est mâché par l'IA.

De même, pour la formation, on peut demander « Donne-moi 5 scénarios d'accidents liés au travail en hauteur pour animer un atelier de sensibilisation » – l'IA fournira des idées de mises en situation réalistes à discuter en équipe.

2. Analyse des risques assistée

Via des prompts bien pensés, l'IA peut aider à analyser des données d'incident. Par exemple : « Voici la description de 10 accidents survenus dans notre usine. Identifie les causes racines communes et suggère des mesures préventives globales ».

En quelques instants, l'agent conversationnel passera en revue les textes, repérera peut-être que la fatigue ou un certain type d'erreur revient fréquemment, et proposera des pistes (améliorer la formation, rajouter une pause, renforcer le contrôle machine…).

Cela équivaut à doter le préventeur d'un assistant analytique capable de dégager des tendances qu'il aurait mis des heures à identifier manuellement. Le prompt engineering sert ici à bien circonscrire la tâche de l'IA (lui fournir les données pertinentes, préciser le format de réponse souhaité, etc.).

3. Veille réglementaire intelligente

Le cadre légal de la SST évolue sans cesse. En formulant des requêtes ciblées du type : « Quelles sont les nouvelles obligations en SST introduites au Québec en 2024 ? Résume-les en listant les actions à entreprendre pour s'y conformer », l'IA peut parcourir les textes de loi et actualités disponibles et fournir un digest exploitable.

Bien sûr, il faut s'assurer que l'IA dispose des données à jour (d'où l'importance de coupler l'IA à des bases de données juridiques fiables). Le prompt va guider l'IA pour qu'elle ne digresse pas et qu'elle sorte la synthèse utile (par ex. « 1. Formation obligatoire sur X ; 2.

Nouveau registre Y à tenir »).

Cela permet aux responsables SST de ne rien rater des changements, sans y consacrer des jours de lecture.

4. Assistants virtuels pour les travailleurs

On voit poindre des chatbots SST à destination directe des employés. Via un simple QR code affiché sur un chantier, un travailleur pourrait interroger un assistant : « Quels EPI dois-je porter pour effectuer telle tâche ? » ou « Comment réagir en cas de déversement de tel produit chimique ? ».

Le système, entraîné et affiné par des prompts élaborés en amont par les experts SST, fournirait la réponse approuvée correspondant aux procédures de l'entreprise. Cela agit comme un rappel instantané des consignes de sécurité, disponible 24/7, et dans la langue de l'employé.

Le défi, ici encore, est d'avoir préparé l'IA avec les bonnes données et les bons prompts pour éviter toute réponse erronée. Mais bien conçu, cet usage démocratise l'accès à l'information SST sur le terrain.

En résumé, le prompt engineering est ce qui permet de passer de la technologie brute à l'outil métier. C'est un peu le chaînon manquant qui traduit les besoins SST en langage compréhensible par l'IA.

Les organisations qui investissent dans ces compétences (former leurs préventeurs à dialoguer avec l'IA, créer des bibliothèques de prompts optimisés) récoltent déjà les fruits : une IA bien guidée peut accomplir en secondes des tâches fastidieuses, tout en s'alignant sur la stratégie de prévention de l'entreprise.

Le mot d'ordre est tout de même la vigilance : l'IA générative, aussi puissante soit-elle, peut se tromper. Le rôle humain reste de valider les suggestions et de garder le contrôle final des décisions en SST. En ce sens, le prompt engineering est autant un art qu'une science, qui nécessite de la rigueur pour exploiter l'IA en toute fiabilité.

Quel cadre légal ? Risques et responsabilités en 2025

L'essor de l'IA générative en SST s'accompagne de questions juridiques et éthiques inédites. Au Québec et au Canada, le cadre réglementaire commence à peine à se construire :

Cadre législatif émergent

D'une part, le projet de Loi sur l'intelligence artificielle et les données (LIAD) au fédéral vise à encadrer les systèmes d'IA à impact élevé. Mais au stade actuel (avril 2025), cette loi n'est pas encore en vigueur. Surtout, elle cible principalement les usages commerciaux de l'IA.

Les experts – notamment l'Observatoire IA Québec – ont souligné qu'en l'état, les outils d'IA utilisés par le secteur public (p.ex. par un ministère ou un hôpital) ne seraient pas couverts par cette loi. Autrement dit, si une institution publique utilisait un agent IA en SST, ce dernier ne serait pas soumis aux mêmes obligations de transparence ou de certification que dans le privé.

Cela représente un vide juridique potentiel, qui pourrait être comblé soit lors des débats parlementaires, soit via d'autres lois ou politiques internes au secteur public.

Responsabilité en cas d'erreur

D'autre part, la responsabilisation en cas d'erreur de l'IA demeure un point flou. Imaginons qu'un assistant IA fournisse un conseil de sécurité inapproprié qui mène à un incident : qui sera tenu responsable ?

En 2024, le Centre de recherche en droit public (CRDP) notait l'absence de sanctions spécifiques pour les usages abusifs ou les dérives de l'IA. En 2025, cette observation reste valable – aucune loi n'indique clairement par exemple qu'utiliser ChatGPT de manière irresponsable est passible de sanction.

Ce sont plutôt les conséquences qui pourraient être sanctionnées via les lois existantes (par ex., un employeur pourrait être jugé négligent s'il se reposait aveuglément sur une IA défaillante). On entre ici dans des zones grises du droit, que les tribunaux n'ont pas encore tranchées.

Par précaution, les entreprises traitent l'IA un peu comme n'importe quel outil logiciel : elles mettent en place des politiques d'utilisation, des revues humaines des résultats de l'IA, et s'assurent de conserver la traçabilité des décisions.

Enjeux éthiques et acceptabilité

Enfin, il y a l'aspect éthique et acceptabilité. Sur le terrain, l'introduction de l'IA générative peut susciter des inquiétudes chez les travailleurs (« Mon patron va-t-il utiliser l'IA pour me surveiller en permanence ? », « Mes données d'accident vont-elles alimenter une machine que je ne comprends pas ? »).

Il est crucial d'impliquer les comités SST et les employés dans le déploiement de ces technologies, de façon transparente. Par exemple, expliquer que le but est d'aider et non de fliquer, ou encore garantir que l'IA respecte la vie privée (pas de données personnelles traitées sans consentement).

Jusqu'ici, aucune réglementation spécifique en SST n'encadre l'IA, mais les principes généraux (dignité, respect de la vie privée, droit à la déconnexion, etc.) s'appliquent. En 2025, on assiste aux premières réflexions syndicales et patronales sur un « usage responsable de l'IA » dans les milieux de travail – c'est un dossier à suivre, qui probablement aboutira à des guides de bonnes pratiques, voire à de nouvelles clauses dans les conventions collectives.

Conclusion : Saisir l'opportunité en gardant l'humain au centre

Loin d'être un gadget de plus, l'IA générative s'affirme comme une opportunité exceptionnelle pour repenser la santé-sécurité au travail. Au Québec et au Canada, de plus en plus d'organisations intègrent ces outils pour prévenir les accidents, améliorer la conformité et gagner en efficacité dans la gestion des risques.

Le prompt engineering se révèle un atout stratégique : il permet de tirer le meilleur de l'IA en l'alignant sur nos objectifs de prévention et nos valeurs de sécurité. Cependant, technologie ne rime pas avec miracle. Pour que la promesse devienne réalité, chaque entreprise doit adopter une démarche proactive : former ses équipes SST aux bases de l'IA, expérimenter sur de petits projets pilotes, définir des lignes directrices éthiques claires.

Les responsables SST, en particulier, ont l'occasion de devenir les chefs d'orchestre de cette transformation digitale en cours. En travaillant main dans la main avec les experts en IA (internes ou partenaires), ils peuvent créer des solutions sur mesure qui répondent aux vrais besoins du terrain.

Feuille de route pour agir

Se renseigner et se former – Inscrivez-vous à des formations courtes sur l'IA générative, suivez des webinaires (beaucoup sont offerts par des universités ou des organismes spécialisés en SST), et testez par vous-même des outils comme ChatGPT pour évaluer leurs réponses en matière de sécurité. La curiosité est le point de départ.

Identifier un cas d'usage prioritaire – Choisissez un problème SST épineux que l'IA pourrait aider à résoudre. Par exemple, l'analyse des quasi-accidents, ou la traduction de procédures en plusieurs langues, ou la formation des nouveaux employés. Commencez par un projet pilote bien circonscrit.

Collaborer avec vos équipes et partenaires – Impliquez le personnel terrain et les membres du comité SST pour définir le prompt idéal, tester l'outil et donner du feedback. Si vous avez un département TI ou innovation, collaborez avec eux pour assurer la sécurité et l'intégration technique de la solution.

Évaluer et ajuster – Mesurez les résultats obtenus (le temps gagné, le nombre d'erreurs évitées, la satisfaction des utilisateurs). Ajustez les prompts, affinez les règles. Le prompt engineering s'améliore par itération : ce qui sort de l'IA au début pourra être significativement optimisé après quelques cycles d'ajustement.

Déployer graduellement et encadrer – Si le pilote est concluant, élargissez l'utilisation à d'autres sites ou d'autres fonctions, tout en maintenant un encadrement clair (politiques d'utilisation, validation humaine des outputs critiques, etc.). Communiquez sur les succès (un accident évité, une tâche accomplie plus vite) pour mobiliser l'adhésion.

En suivant ces étapes, votre organisation pourra embrasser l'IA de façon responsable. L'IA générative n'en est qu'à ses débuts en SST, mais les gains potentiels – en vies épargnées, en pénibilité réduite, en conformité assurée – valent la peine qu'on s'y intéresse dès maintenant.

L'appel à l'action est donc le suivant : ne pas subir la vague de l'IA, mais en devenir acteur. Il s'agit d'expérimenter intelligemment, d'apprendre collectivement et de partager les bonnes pratiques. Ainsi, la santé-sécurité au travail pourra franchir un cap, en restant fidèle à sa mission première : protéger humainement les travailleurs, avec les meilleurs outils technologiques du moment.

En 2025, la technologie est prête – à nous de jouer ! Les pionniers de l'IA en SST d'aujourd'hui seront les référents de demain. Et vous, quel sera votre premier projet IA en santé-sécurité ?

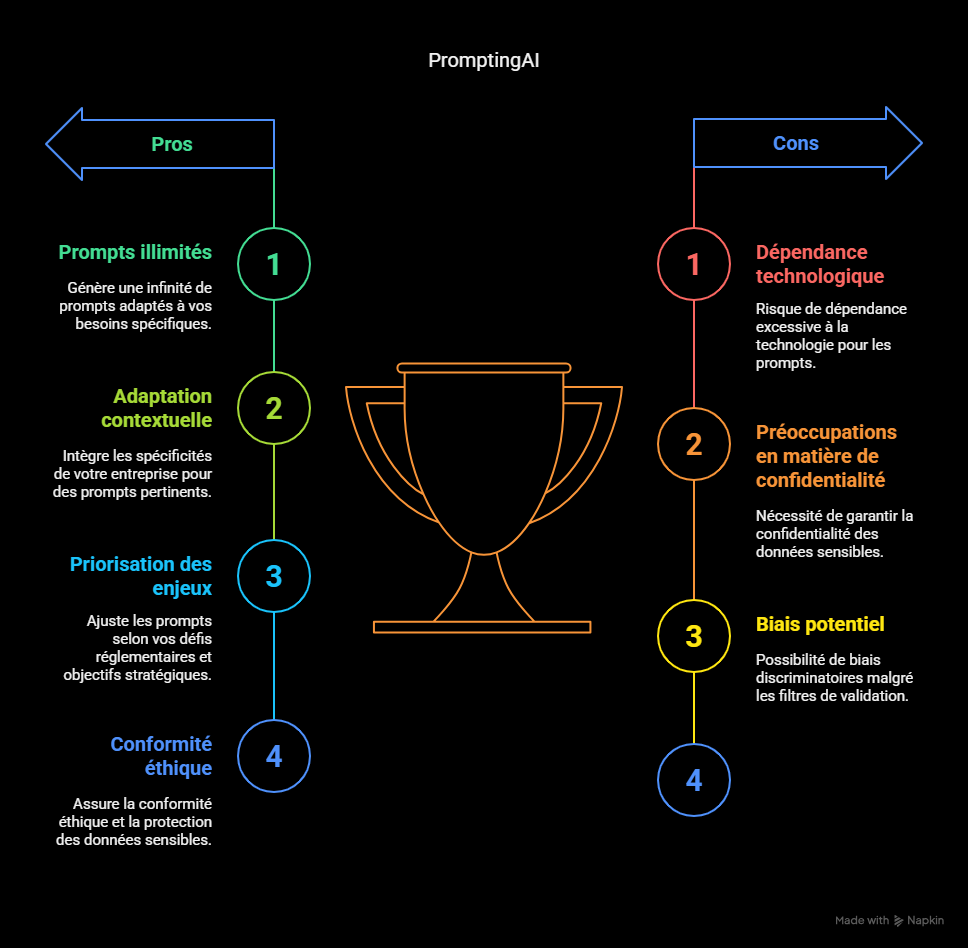

PromptingAI de GenAISafety : Un générateur intelligent de métaprompts certifiés

Face au potentiel et aux défis de l'IA en santé-sécurité, GenAISafety a développé PromptingAI, un moteur intelligent de génération de métaprompts certifiés, spécialement conçu pour les professionnels HSE souhaitant exploiter l'IA générative de manière éthique, sécuritaire et parfaitement adaptée à leur contexte d'entreprise.

Qu'est-ce que PromptingAI ?

PromptingAI n'est pas une simple bibliothèque statique, mais un véritable moteur de génération intelligent qui :

Crée des prompts illimités et adaptés : Contrairement aux solutions basiques offrant un nombre limité de templates, PromptingAI peut générer une infinité de prompts parfaitement calibrés à partir de plus de 100 métaprompts certifiés qui servent de base à son intelligence. Le système analyse votre besoin spécifique et génère le prompt optimal en temps réel.

S'adapte au contexte unique de votre entreprise : Le moteur intègre automatiquement :

Votre secteur d'activité et ses risques spécifiques

La taille et structure de votre organisation

Votre maturité en matière de SST

Vos processus internes et documentation existante

Les incidents historiques pertinents dans votre domaine

Votre culture d'entreprise et terminologie spécifique

Prend en compte vos enjeux prioritaires : L'intelligence du système permet d'ajuster les prompts selon :

Les défis réglementaires auxquels vous faites face

Vos objectifs stratégiques en SST

Les risques émergents dans votre secteur

Les préoccupations spécifiques de vos équipes

Les points d'amélioration identifiés lors d'audits précédents

Garantit éthique et sécurité : Chaque prompt généré passe par un filtre de validation qui assure :

La conformité avec les normes éthiques d'utilisation de l'IA

L'absence de biais discriminatoires

La protection des données sensibles

La transparence dans les sources utilisées

La prévention des risques d'hallucination de l'IA

La sécurité des recommandations formulées

Paramètres personnalisés pour une précision maximale

PromptingAI se distingue par sa capacité de personnalisation avancée permettant d'ajuster les paramètres selon :

Niveau de complexité réglementaire : De la PME locale à la multinationale soumise à des normes internationales

Spécificités sectorielles : Construction, santé, industrie lourde, agroalimentaire, services, etc.

Profils d'utilisateurs : De l'expert SST au manager de première ligne

Niveau de détail requis : Du résumé exécutif à l'analyse approfondie

Format de sortie : Rapports, listes d'actions, diagrammes, procédures, questionnaires d'audit, etc.

Contraintes locales : Adaptation aux réalités régionales (conditions climatiques, normes provinciales, etc.)

Une technologie évolutive qui apprend de votre expertise

L'intelligence de PromptingAI s'améliore continuellement :

Apprentissage continu : Le système intègre les retours d'expérience pour affiner ses recommandations

Veille réglementaire automatisée : Mise à jour constante des exigences légales (comme la réforme CNESST ou les nouvelles dispositions sur les risques psychosociaux)

Enrichissement collaboratif : Chaque nouvelle utilisation renforce la pertinence du système pour l'ensemble des utilisateurs, tout en préservant la confidentialité

Évaluation de performance : Métriques permettant de mesurer l'impact concret des prompts générés sur vos indicateurs SST

Témoignages d'utilisateurs

"PromptingAI a révolutionné notre approche de la SST. Le système comprend nos enjeux spécifiques et génère des prompts qui semblent avoir été créés par un expert connaissant parfaitement notre entreprise. Notre équipe peut désormais se concentrer sur l'intervention terrain plutôt que sur la paperasse." - Sarah, Directrice SST, entreprise manufacturière

"La capacité d'adaptation du générateur aux nouvelles exigences sur les risques psychosociaux nous a considérablement aidés à préparer notre plan d'action pour octobre 2025. Nous apprécions particulièrement les filtres éthiques qui garantissent des recommandations toujours responsables et applicables." - Marc, Conseiller en prévention

Comment accéder à PromptingAI ?

GenAISafety propose différentes formules d'accès à son générateur intelligent de métaprompts :

Accès en ligne : Interface web sécurisée permettant de générer des prompts personnalisés à la demande disponible sur genaisafety.online/mastering-hse-ingeneering-prompts

Formation certifiante : Parcours complet pour maîtriser l'utilisation avancée du générateur et ses paramètres de personnalisation (présentiel ou distanciel)

Solution entreprise : Intégration du moteur PromptingAI dans vos systèmes existants, avec personnalisation complète selon vos processus, documentation et historique SST

Accompagnement expert : Services de conseil pour définir votre stratégie d'IA en SST et optimiser l'utilisation du générateur selon vos objectifs spécifiques

Pour en savoir plus ou demander une démonstration, visitez genaisafety.online ou contactez directement l'équipe d'experts.

PrevIA-SST est une intelligence artificielle dédiée aux Comités de Santé et Sécurité au Travail (SST). Son objectif est d'automatiser et d'optimiser les activités des comités SST en facilitant la détection des risques, le suivi des incidents, la conformité réglementaire et la prévention proactive en entreprise

#SantéSécurité #IAgénérative #SST #IntelligenceArtificielle #Prévention #Conformité #ChatGPT #PromptEngineering #TransformationDigitale #InnovationSST #Industrie4_0 #GenAISafety #RisquesProfessionnels #SécuritéAuTravail #TechnologieResponsable

Sources

KPMG Canada, "Étude sur l'adoption de l'IA générative au Québec", 2024

Deloitte, "Indice d'adoption numérique", 2024

IBM, "Safety Index Report", 2023 (citation non confirmée publiquement)

Observatoire IA Québec, "Analyse du cadre réglementaire", 2024

Centre de recherche en droit public (CRDP), "Encadrement juridique de l'IA au Québec", 2024

Conseil de l'innovation du Québec, "Rapport sur l'intégration de l'IA dans les flux de travail", 2024

Commentaires